技术摘要:

本发明公开了一种句子级卷积LSTM的训练方法,包括:将句子中当前及邻近单词上一时刻的隐藏状态通过一维卷积的方式聚合,并作为句子向量输入;将句子的当前单词当前时刻的子状态作为单词向量输入;将句子向量输入、单词向量输入和当前单词上一时刻的细胞状态送入逻辑门 全部

背景技术:

长短期记忆网络(LSTM)拥有强大的序列信息抽取能力,是目前主流 的文本表示 工具。迄今为止,它在语言建模,机器翻译,句法分析,问答 等自然语言处理任务中都取得 了最先进的成果。 传统的循环神经网络将句子建模为具有链式结构的序列数据,在每个 时间步下, 通过输入一个当前时间步的单词状态和一个上一时间步的隐藏 状态来输出当前时刻具有 上文信息的隐藏状态。然而,如果输入序列长度 过长,循环神经网络往往会出现梯度消失 和梯度爆炸问题,从而不能够很 好的学习到序列中的长期依赖信息。 现有技术中,SRU它使用点积、耦合等操作来简化LSTM中各个门的 状态运算过程, 从而提高了并行性;SRNN,通过将句子切成多个子句,并 在多个子句中使用独立的LSTM,实 现了子句的并行计算,提高了并行计 算能力。然而,以上两种方法仍然在时间维度上表现 较差。

技术实现要素:

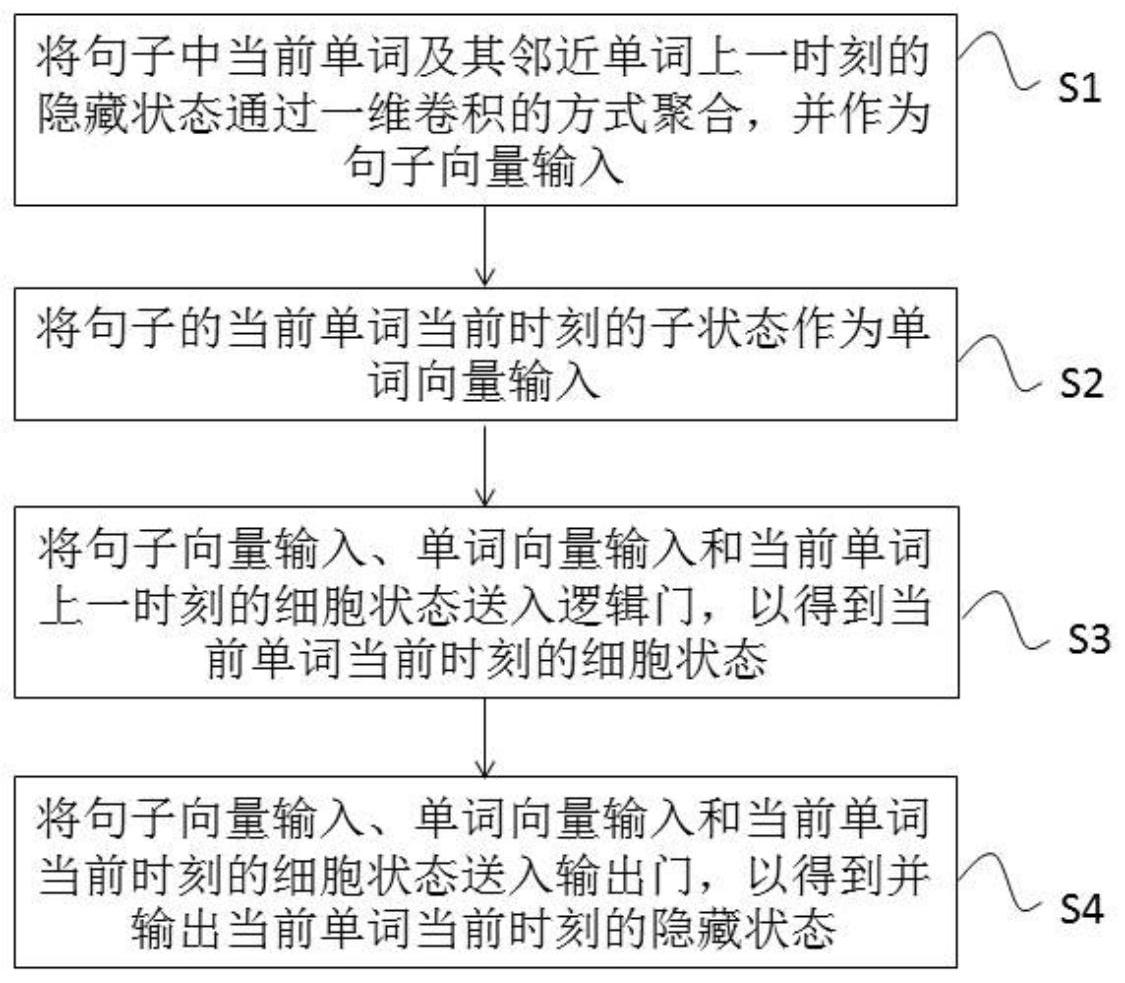

有鉴于此,本发明实施例的目的在于提出一种句子级卷积LSTM的训 练方法、设备 及可读介质,通过将一个整体的句子看作一个包含句子长度 个单词级子状态的单一状态, 使用一维卷积来聚合每个单词周围的本地信 息,并通过堆叠的方式实现本地信息和上文 信息的交互,利用逻辑门控制 细胞状态中的信息更新和因此状态输出,大大提高了并行计 算能力,节约 了时间、资金成本。 基于上述目的,本发明实施例的一方面提供了一种句子级卷积LSTM 的训练方法, 包括如下步骤:将句子中当前单词及其邻近单词上一时刻的 隐藏状态通过一维卷积的方 式聚合,并作为句子向量输入;将句子的当前 单词当前时刻的子状态作为单词向量输入; 将句子向量输入、单词向量输 入和当前单词上一时刻的细胞状态送入逻辑门,以得到当前 单词当前时刻 的细胞状态;以及将句子向量输入、单词向量输入和当前单词当前时刻的 细胞状态送入输出门,以得到并输出当前单词当前时刻的隐藏状态。在一 些实施方式中, 基于数据域值对非易失性内存进行分区包括:基于非易失 性内存大小和硬盘个数设定数 据阈值;将非易失性内存进行分区,使每个 分区内存大小为数据域值。 在一些实施方式中,将句子中当前单词及其邻近单词上一时刻的隐藏 状态通过 一维卷积的方式聚合,并作为句子向量输入包括:将上一单词上 一时刻的隐藏状态、当前 单词上一时刻的隐藏状态和下一单词上一时刻的 隐藏状态进行一维卷积,生成当前单词 上一时刻的句子向量输入。 在一些实施方式中,将句子向量输入、单词向量输入和当前单词上一 时刻的细胞 4 CN 111597792 A 说 明 书 2/7 页 状态送入逻辑门包括:将句子向量输入、单词向量输入和当前 单词上一时刻的细胞状态送 入遗忘门,以丢弃当前单词上一时刻的细胞状 态的部分信息。 在一些实施方式中,将句子向量输入、单词向量输入和当前单词上一 时刻的细胞 状态送入逻辑门包括:将句子向量输入、单词向量输入和当前 单词上一时刻的细胞状态送 入输入门,以向当前单词上一时刻的细胞状态 加入新的部分信息。 在一些实施方式中,还包括:将当前单词当前时刻的隐藏状态和上一 单词当前时 刻的隐藏状态、下一单词当前时刻的隐藏状态进行一维卷积, 生成当前单词下一时刻的句 子向量输入,以进入下一循环。 本发明实施例的另一方面,还提供了一种计算机设备,包括:至少一 个处理器;以 及存储器,存储器存储有可在处理器上运行的计算机指令, 指令由处理器执行时实现以下 步骤:将句子中当前单词及其邻近单词上一 时刻的隐藏状态通过一维卷积的方式聚合,并 作为句子向量输入;将句子 的当前单词当前时刻的子状态作为单词向量输入;将句子向量 输入、单词 向量输入和当前单词上一时刻的细胞状态送入逻辑门,以得到当前单词当 前 时刻的细胞状态;以及将句子向量输入、单词向量输入和当前单词当前 时刻的细胞状态送 入输出门,以得到并输出当前单词当前时刻的隐藏状态。 在一些实施方式中,将句子中当前单词及其邻近单词上一时刻的隐藏 状态通过 一维卷积的方式聚合,并作为句子向量输入包括:将上一单词上 一时刻的隐藏状态、当前 单词上一时刻的隐藏状态和下一单词上一时刻的 隐藏状态进行一维卷积,生成当前单词 上一时刻的句子向量输入。 在一些实施方式中,将句子向量输入、单词向量输入和当前单词上一 时刻的细胞 状态送入逻辑门包括:将句子向量输入、单词向量输入和当前 单词上一时刻的细胞状态送 入遗忘门,以丢弃当前单词上一时刻的细胞状 态的部分信息。 在一些实施方式中,将句子向量输入、单词向量输入和当前单词上一 时刻的细胞 状态送入逻辑门包括:将句子向量输入、单词向量输入和当前 单词上一时刻的细胞状态送 入输入门,以向当前单词上一时刻的细胞状态 加入新的部分信息。 本发明实施例的再一方面,还提供了一种计算机可读存储介质,计算 机可读存储 介质存储有被处理器执行时实现如上方法步骤的计算机程序。 本发明具有以下有益技术效果:通过将一个整体的句子看作一个包含 句子长度 个单词级子状态的单一状态,使用一维卷积来聚合每个单词周围 的本地信息,并通过堆叠 的方式实现本地信息和上文信息的交互,利用逻 辑门控制细胞状态中的信息更新和因此 状态输出,大大提高了并行计算能 力,节约了时间、资金成本。 附图说明 为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对 实施例或 现有技术描述中所需要使用的附图作简单地介绍,显而易见地, 下面描述中的附图仅仅是 本发明的一些实施例,对于本领域普通技术人员 来讲,在不付出创造性劳动的前提下,还 可以根据这些附图获得其他的实 施例。 图1为本发明提供的句子级卷积LSTM的训练方法的实施例的示意图; 图2为本发明提供的句子级卷积LSTM的训练方法的全局范围隐藏状 态卷积图; 5 CN 111597792 A 说 明 书 3/7 页 图3为本发明提供的句子级卷积LSTM的训练方法的内部运行图。