技术摘要:

本发明公开了一种RGB‑D显著性目标检测方法,所述方法包括以下步骤:通过单模态特征提取,分别获取RGB图和深度图的每一级的单模态显著性特征;通过跨模态联合特征提取对每一级的RGB和深度单模态显著性特征进行选择,逐级捕获RGB图和深度图的互补特征,生成跨模态联合特 全部

背景技术:

在面对复杂的自然场景时,人类视觉系统具有快速搜索并定位感兴趣区域和目标 的能力。通过将视觉注意力机制引入到计算机视觉中,可以优化计算资源,使视觉信息的处 理更符合人眼视觉特征。显著性目标检测旨在自动识别不同场景中的显著性区域,已广泛 地应用于分割、重定向、检索、编码、分类等任务。近年来,图像显著性目标检测取得了令人 瞩目的进展。实际上,人类视觉系统还具有感知场景中深度信息的能力,深度信息可以作为 彩色图的互补信息,应用到显著性目标检测任务中。随着相机设备的快速发展,深度图的获 取变得越来越便捷,促进了RGB-D显著性目标检测的研究。 传统的RGB-D显著性目标检测的方法将深度信息作为彩色信息的补充,通过设计 手工特征来捕获信息。Peng等人将RGB-D图像对作为四通道的输入,送入多阶段显著性推理 模型。Song等人结合四通道的数据和传统技术计算多尺度的显著性值。Liang等人利用对比 度和深度背景先验知识,提出了立体显著性检测模型。然而,这些算法受限于无法有效地捕 获图像的高级语义特征,并且直接将不同模态的特征进行整合,可能会造成特征不匹配或 带来冗余信息。 最近,基于卷积神经网络(Convolutional Neural Network,CNN)的方法成为RGB- D显著性检测任务的主流。与传统的方法相比,基于CNN的方法能够提取并融合高级语义特 征和低级纹理特征。大多数基于CNN的方法采用两流架构,以自底向上的方式分别提取RGB 和深度特征,然后集成到后处理步骤中进行融合。Han等人提出了一个双流网络来提取RGB 和深度特征,然后利用全连接层整合这些特征预测最终的显著性图。Ding等人利用两个不 同的CNN来分别预测RGB流和深度流的显著性图,并在显著性融合网络中进行融合。 发明人在实现本发明的过程中,发现现有技术中至少存在以下缺点和不足: 首先,现有技术大多利用两个独立的显著性检测模型来提取单模态的特征,这种 方式忽略了RGB特征和深度特征之间的互补性。因此,如何在特征提取的过程中逐步结合跨 模态特征仍需要进一步探索。其次,在后期融合策略中,现有技术大多通过像素级相加或相 乘的方式,融合RGB流和深度流的显著性预测,这种简单的融合方式没有充分利用两流的预 测,无法有效地突出完整的显著性目标、抑制背景区域。

技术实现要素:

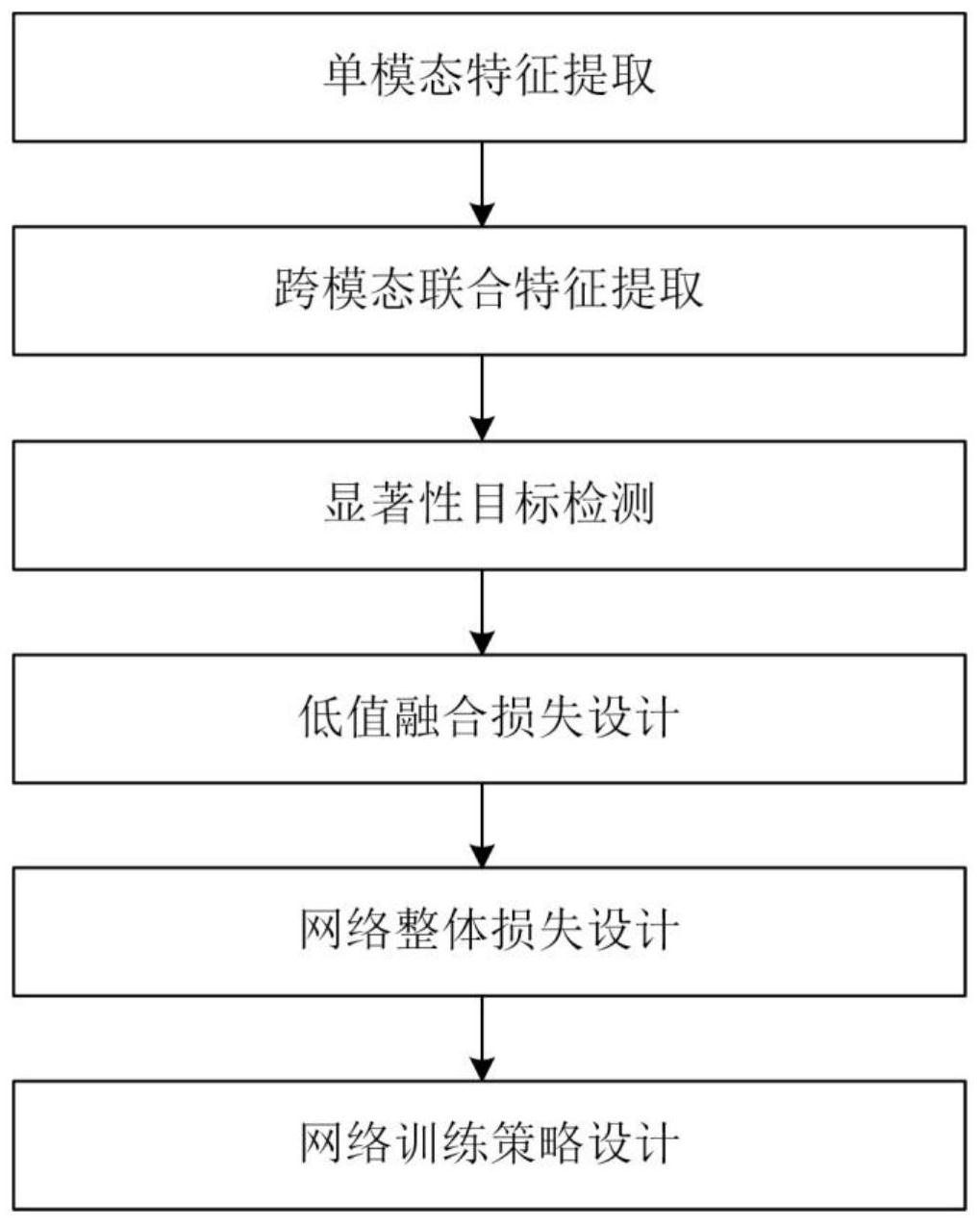

本发明提供了一种RGB-D显著性目标检测方法,通过跨模态联合特征提取捕获有 价值的跨模态联合特征,并通过设计的低值融合损失使网络关注显著性图的低值显著性区 域,提高显著性值的下界,详见下文描述: 一种RGB-D显著性目标检测方法,所述方法包括以下步骤: 3 CN 111582316 A 说 明 书 2/6 页 通过单模态特征提取,分别获取RGB图和深度图的每一级的单模态显著性特征; 通过跨模态联合特征提取对每一级的RGB和深度单模态显著性特征进行选择,逐 级捕获RGB图和深度图的互补特征,生成跨模态联合特征; 将跨模态联合特征和单模态显著性特征输入到显著性目标检测部分; 通过设计低值融合损失和网络整体损失,实现RGB流和深度流检测结果的融合和 网络的监督学习,输出最终的显著性检测结果。 其中,所述单模态特征提取基于VGG-16模型,包含五组卷积块,每组卷积块由相应 的卷积层和池化层组成; 去掉第五组卷积块中最后一层池化层,并在后面加入了四个并行的空洞卷积捕获 全局多感受野信息,四个空洞卷积输出的特征进行级联,组成第五组卷积块的输出。 进一步地,所述跨模态联合特征提取具体为: 在单模态特征提取过程中,先对RGB和深度单模态显著性特征进行空间特征选择, 然后结合形成跨模态联合特征表示;跨模态特征表示经过通道注意力模块重新加权,生成 加权后的RGB-D特征;加权后的RGB-D特征、RGB特征和深度特征进行结合,生成每一级的跨 模态联合特征。 其中,所述跨模态联合特征具体为: 其中,Up(·)表示利用双线性插值的上采样操作, 即为跨模态联合特征提取模 块的输出, 为经过一个通道注意力模块产生加权后的RGB-D特征, 为RGB特征, 为深 度特征,Conv(·)表示卷积操作。 进一步地,所述显著性目标检测部分包括RGB和深度显著性目标检测,两部分采用 相同的结构, 每一部分都设计了五个融合块为了整合单模态的多尺度特征和跨模态的联合特 征,提高每流显著性目标检测的精度; 单模态的多尺度特征由两个卷积层和上采样层捕获,在每个融合块中,每级捕获 的多尺度特征和联合特征通过通道级联和卷积进行整合,生成更新后的显著性特征。 其中,所述低值融合损失具体为: 其中,k表示像素的索引, 和 分别表示RGB流和深度流预测的显著性值,Gk表 示真值,||·||2为2范数,N为图像的像素个数。 本发明提供的技术方案的有益效果是: 1、本发明通过设计跨模态联合特征提取部分和显著性目标检测部分,有效地整合 了RGB图像和深度图的互补信息,提高了每流显著性检测的精度; 2、本发明通过设计低值融合损失,有效建立了两流显著性检测之间的关系,使网 络关注显著性值较低的区域,提高显著性值的下界,本发明取得了良好的显著性目标检测 性能。 4 CN 111582316 A 说 明 书 3/6 页 附图说明 图1为一种RGB-D显著性目标检测方法的流程图; 图2为一种RGB-D显著性目标检测方法的具体实施框架; 图3为跨模态特征提取模块(CFM)和RGB显著性检测部分中融合块(FB)的结构图; 图4为检测结果的示意图。