技术摘要:

本发明实施例提供了一种无人驾驶室外场景三维重建的方法和系统,通过比较前后两帧视觉图像、位姿的变化差异,判断是以视觉数据作为位姿还是以IMU数据作为位姿,从而降低了环境对室外三维重建的影响。IMU数据量比较小,误差消除和积分处理速度很快,因此本发明与现有的 全部

背景技术:

现有的室外三维场景重建大多数是通过视觉类传感器获取深度图和彩色图。之后 采用特征点匹配或者ICP点云匹配的方法计算得到一系列关联帧之间的相机位姿变化关 系。再利用回环检测等方式进行局部优化或整体优化,进一步提高位姿的准确性。最后利用 得到的位姿关系进行点云融合,建立稠密三维点云模型。 而目前室外三维场景重建存在的主要问题之一是鲁棒性低,准确性差。比如在室 外场景中,当相机从向阳处移动至背光处时,画面的亮度会发生突变,瞬间由非常亮变成非 常暗。这将导致相机很难从捕捉的画面中准确判断自身的运动,继而使得建模的效果不理 想。再比如,在一些纹理信息不够丰富、深度变化不明显的区域,如树木、栏杆等区域,因为 缺少足够的视觉信息而无法进行准确的匹配,从而影响到整体建模效果。

技术实现要素:

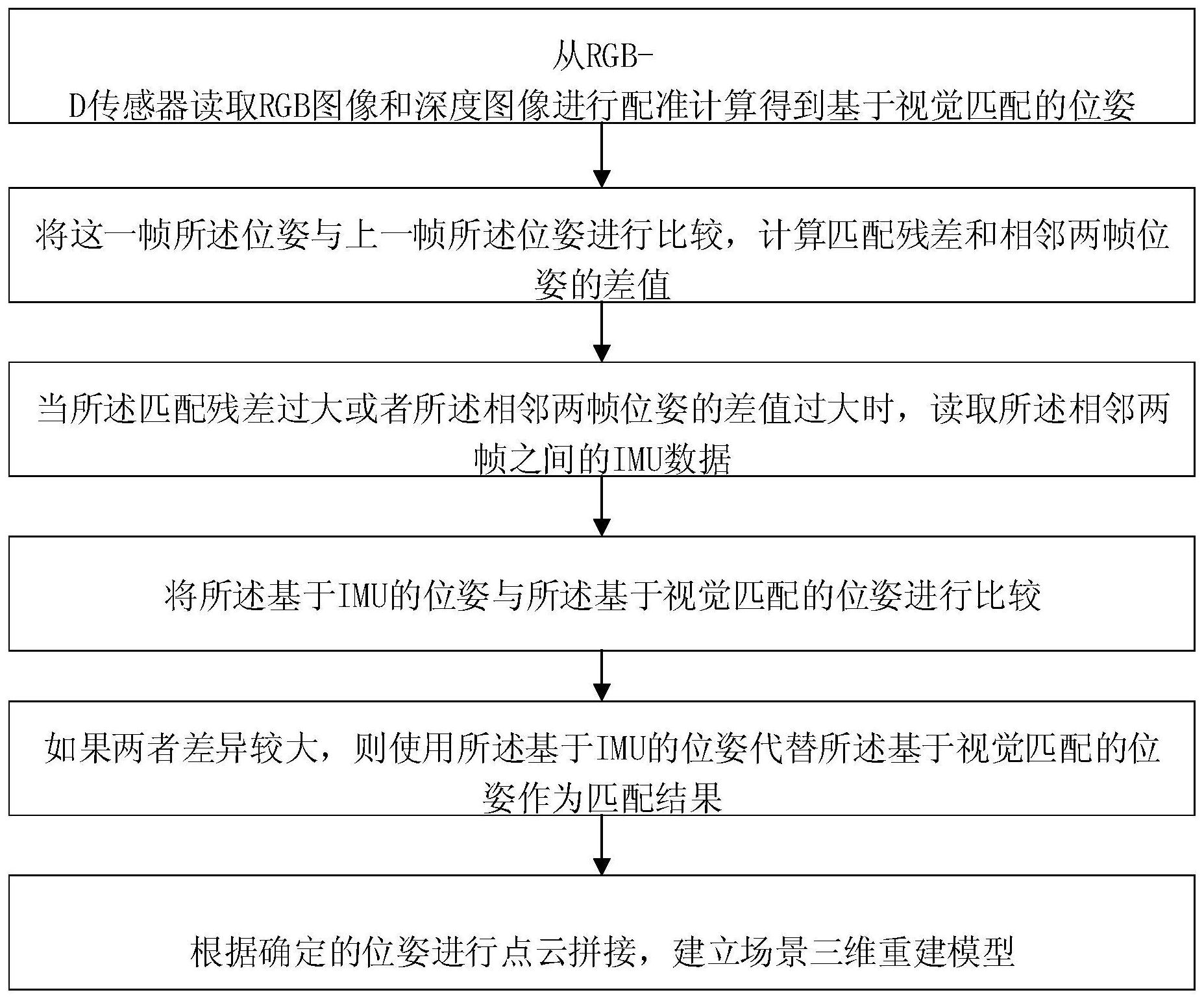

鉴于上述问题,提出了本发明,以便提供一种无人驾驶室外场景三维重建的方法 和系统。 在本发明的一个实施例中,提供了一种无人驾驶室外场景三维重建的方法,其特 征在于,包括: 步骤S101,从RGB-D传感器读取RGB图像和深度图像进行配准计算得到基于视觉匹 配的位姿; 步骤S102,得到所述基于视觉匹配的位姿后,将这一帧所述位姿与上一帧所述位 姿进行比较,计算匹配残差和相邻两帧位姿的差值; 步骤S103,当所述匹配残差过大或者所述相邻两帧位姿的差值过大时,读取所述 相邻两帧之间的IMU数据,对所述IMU数据进行误差消除和积分处理,得到基于IMU的位姿; 步骤S104,将所述基于IMU的位姿与所述基于视觉匹配的位姿进行比较; 步骤S105,如果两者较为相似,则认为所述基于视觉匹配的位姿正确; 步骤S106,如果两者差异较大,则使用所述基于IMU的位姿代替所述基于视觉匹配 的位姿作为匹配结果; 步骤S107,根据确定的位姿进行点云拼接,建立场景三维重建模型。 进一步的,其中步骤一中还包括:使用ICP算法对所述基于视觉匹配的位姿进行计 算修正。 在本发明的另一个实施例中,提供了一种无人驾驶室外场景三维重建的系统,其 特征在于,包括: 视觉图像处理模块,用于从RGB-D传感器读取RGB图像和深度图像进行配准计算得 3 CN 111583387 A 说 明 书 2/6 页 到基于视觉匹配的位姿; 计算模块,用于得到所述基于视觉匹配的位姿后,将这一帧所述位姿与上一帧所 述位姿进行比较,计算匹配残差和相邻两帧位姿的差值; IMU数据处理模块,用于当所述匹配残差过大或者所述相邻两帧位姿的差值过大 时,读取所述相邻两帧之间的IMU数据,对所述IMU数据进行误差消除和积分处理,得到基于 IMU的位姿; 比较模块,用于将所述基于IMU的位姿与所述基于视觉匹配的位姿进行比较; 判断模块,用于如果两者较为相似,则认为所述基于视觉匹配的位姿正确;如果两 者差异较大,则使用所述基于IMU的位姿代替所述基于视觉匹配的位姿作为匹配结果; 三维重建模块,用于根据确定的位姿进行点云拼接,建立场景三维重建模型。 进一步的,其中视觉图像处理模块还用于:使用ICP算法对所述基于视觉匹配的位 姿进行计算修正。 本发明实施例提供了一种无人驾驶室外场景三维重建的方法和系统,通过比较前 后两帧视觉图像、位姿的变化差异,判断是以视觉数据作为位姿还是以IMU数据作为位姿, 从而降低了环境对室外三维重建的影响。IMU数据量比较小,误差消除和积分处理速度很 快,因此本发明与现有的纯视觉方案相比,计算量基本不变。但加入IMU数据后,可以分别利 用IMU和RGB-D相机各自的优势,降低环境对现有的建模方案的影响,提高建模的准确性和 鲁棒性。 附图说明 为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现 有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本发 明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根 据这些附图获得其他的附图。 图1为本发明一实施例提供的无人驾驶室外场景三维重建的方法的流程示意图; 图2为本发明另一实施例提供的无人驾驶室外场景三维重建的系统的结构示意 图;