技术摘要:

提供了一种电子设备,包括包含电路的麦克风、包含电路的扬声器和电连接到麦克风和扬声器的处理器,其中,处理器被配置为,当通过麦克风输入了第一用户语音时,识别发出第一用户语音的用户,并通过扬声器提供通过将第一用户语音输入到经过人工智能算法训练的人工智能模 全部

背景技术:

近年来,实现人类智能水平的人工智能系统已应用于各个领域。与传统的基于规 则的智能系统不同,人工智能系统是一个机器自身训练、确定并变得智能的系统。随着人工 智能系统的使用,提高了识别率,更准确地理解用户喜好,因此,传统的基于规则的系统逐 渐被基于深度学习的人工智能系统所取代。 人工智能技术由机器学习(如深度学习)和使用机器学习的基本技术组成。机器学 习是对输入数据的特征进行自分类/自训练的算法技术,而基本技术是利用机器学习算法 (诸如深度学习)来模拟人类大脑功能诸如识别或确定的技术,由语言理解、视觉理解、推 理/预测、知识表示、操作控制等等技术领域组成。 人工智能技术应用于如下各个领域。语言理解是识别人类语言/字母并对其进行 应用/处理的技术,且包括自然语言处理、机器翻译、转换系统、问答、语音识别/合成,等等。 视觉理解是从人类角度来识别物体并对其进行处理的技术,且包括物体识别、物体跟踪、图 像搜索、人体识别、场景理解、空间理解、图像改进,等等。推理/预测是识别信息并对其进行 逻辑推理和预测的技术,且包括基于知识/可能性的推理、优化预测、基于喜好的规划、推 荐,等等。知识表示是执行将人类的实验信息自动处理为知识数据的技术,且包括知识构建 (数据生成/分类)、知识管理(数据应用),等等。操作控制是控制车辆自动行驶或机器人运 动的技术,且包括运动控制(导航、碰撞或行走)、操作控制(行为控制),等等。 与此同时,传统上已经开发出识别用户语音并根据识别出的用户语音提供各种交 互的电子设备。此外,电子设备不仅可以对一次性的用户语音进行响应,还可以接收连续的 用户语音,并通过反映话语历史提供响应。然而,当在连续的用户语音之间接收到另一个用 户的用户语音时,电子设备无法区分这些语音,并会提供完全错误的响应。

技术实现要素:

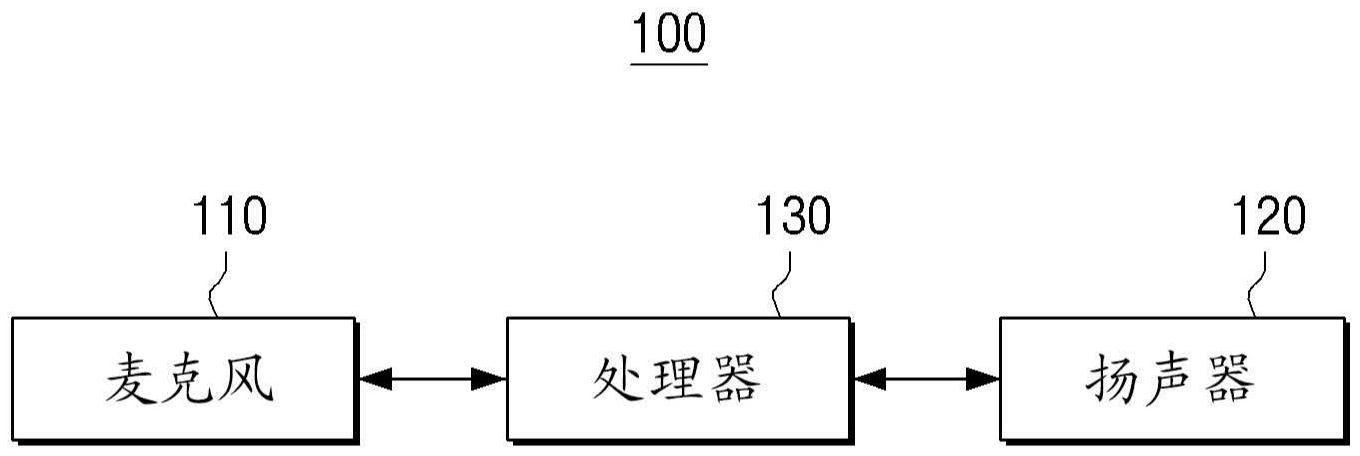

技术问题 本公开是基于上述需要而作出的,且本公开的目的是提供尽管用户的语音分别来 自多个用户的输入,也能提供具有维持上下文的响应的电子设备及其控制方法。 技术方案 为实现上述目标,根据本公开的实施例,提供了一种电子设备,包括麦克风、扬声 器和配置为电连接到麦克风和扬声器的处理器,其中处理器被配置为,基于通过麦克风输 入了第一用户语音,识别发出第一用户语音的用户,通过扬声器提供通过将第一用户语音 5 CN 111587419 A 说 明 书 2/24 页 输入到经过人工智能算法训练的人工智能模型中而获取的第一响应声音,基于通过麦克风 输入了第二用户语音,识别发出第二用户语音的用户,并基于发出第一用户语音的用户与 发出第二用户语音的用户相同,通过扬声器提供通过将第二用户语音和话语历史信息输入 到人工智能模型中而获取的第二响应声音。 该设备可以进一步包括存储器,且处理器可以被配置为,基于发出第二用户语音 的用户与发出第一用户语音的用户不同,将第二用户语音存储在存储器中,以及基于发出 第一用户语音的用户在预定时间周期或更长时间里未输入用户语音,提供通过输入第二用 户语音到人工智能模型中而获取的第三响应声音。 处理器可以被配置为,基于输入的第一用户语音,识别发出第一用户语音的第一 用户,并通过扬声器提供通过将第一用户语音输入到人工智能模型中而获取的第一响应声 音,以及基于输入的第二用户语音,识别发出第二用户语音的第二用户,并通过扬声器提供 通过将第二用户语音输入到人工智能模型中而获取的区别于第一响应声音的第三响应声 音。 处理器可以被配置为,基于第一用户输入了第一附加用户语音,通过扬声器提供 通过将第一附加用户语音和与第一用户语音相对应的第一话语历史信息输入到人工智能 模型中而获取的第一附加响应声音,以及基于第二用户输入了第二附加用户语音,通过扬 声器提供通过将第二附加用户语音和与第二用户语音相对应的第二话语历史信息输入到 人工智能模型中而获取的区别于第一附加响应声音的第二附加响应声音。 该设备可以进一步包括电连接到处理器的显示器,且处理器可以配置为,在提供 第一附加响应声音时,通过显示器显示与第一用户相对应的第一UI,以及在提供第二附加 响应声音时,通过显示器显示与第二用户相对应的第二UI。 处理器可以配置为,基于发出第一用户语音的用户与发出第二用户语音的用户不 同,获取与第一用户语音对应的第一域和与第二用户语音对应的第二域,以及基于第一域 与第二域相同,通过扬声器提供通过向人工智能模型输入第二用户语音和话语历史信息而 获取的第二响应声音。 该设备可以进一步包括电连接到处理器的存储器,并且处理器可以被配置为,基 于在从第一用户语音输入时起的第一预定时间周期内输入的了第二用户语音,发出第一用 户语音的用户与发出第二用户语音的用户相同,且与第一用户语音对应的第一域不同于与 第二用户语音对应的第二域,可以将第一用户语音存储在存储器中,而不提供第一响应声 音,并通过扬声器提供通过将第二用户语音输入到人工智能模型中而获取的第三响应声 音。 处理器可以配置为,基于用户在第二预定时间周期内或更长时间内未输入与第二 域对应的用户语音,通过扬声器提供通过将存储在存储器中的第一用户语音输入到人工智 能模型中而获取的第一响应声音。 该设备可以进一步包括相机,并且处理器可以被配置为,基于相机捕获的图像或 通过麦克风输入的用户语音中的至少一个,来识别用户。 处理器可以被配置为,基于在输入第一用户语音的时间周期内包含在图像中的用 户嘴形,来识别发出第一用户语音的用户,以及基于在输入第二用户语音时间周期内包含 在图像中的已识别出的用户嘴形发生了变化,识别出发出第二用户语音的用户与发出第一 6 CN 111587419 A 说 明 书 3/24 页 用户语音的用户相同。 根据本公开的实施例,提供电子设备的控制方法,该方法包括,基于输入了第一用 户语音,识别发出第一用户语音的用户,提供通过将第一用户语音输入到经过人工智能算 法训练的人工智能模型中而获取的第一响应声音,基于输入了第二用户语音,识别发出第 二用户语音的用户,并基于发出第一用户语音的用户与发出第二用户语音的用户相同,提 供通过将第二用户语音和话语历史信息输入到人工智能模型中而获取的第二响应声音。 该方法可以进一步包括,基于发出第二用户语音的用户与发出第一用户语音的用 户不同,存储第二用户语音,以及基于发出第一用户语音的用户在预定时间周期或更长时 间里未输入用户语音上,提供通过输入第二用户语音到人工智能模型中而获取的第三响应 声音。 识别发出第一用户语音的用户可以包括基于输入的第一用户语音识别发出第一 用户语音的第一用户,提供第一响应声音可以包括提供通过向人工智能模型输入第一用户 语音而获取的第一响应声音,识别发出第二用户语音的用户可以包括识别发出第二用户语 音的第二用户,并且该方法还可以包括提供通过将第二用户语音输入到人工智能模型中而 获取的区别于第一响应声音的第三响应声音。 该方法可以进一步包括,基于第一用户输入了第一附加用户语音,提供通过将第 一附加用户语音和与第一用户语音相对应的第一话语历史信息输入到人工智能模型中而 获取的第一附加响应声音,以及基于第二用户输入了第二附加用户语音,提供通过将第二 附加用户语音和与第二用户语音相对应的第二话语历史信息,输入到人工智能模型中而获 取的区别于第一响应附加声音的第二附加响应声音。 提供第一附加响应声音可以包括:在提供第一附加响应声音时,与第一用户相对 应的第一UI。提供区别于第一附加响应声音的第二附加响应声音可以包括:在提供第二附 加响应声音时,显示与第二用户相对应的第二UI。 该方法可以进一步包括,基于发出第一用户语音的用户与发出第二用户语音的用 户不同,获取与第一用户语音对应的第一域和与第二用户语音对应的第二域,以及基于第 一域与第二域相同,提供通过向人工智能模型输入第二用户语音和话语历史信息而获取的 第二响应声音。 该方法中,基于在从第一用户语音输入时起的第一预定时间周期内输入了第二用 户语音,发出第一用户语音的用户与发出第二用户语音的用户相同,且第一用户语音对应 的第一域与第二用户语音对应的第二域不同,可以将第一用户语音存储在存储器中,而不 提供第一响应声音,并提供通过将第二用户语音输入到人工智能模型中而获取的第三响应 声音。 该方法可以进一步包括,基于用户在第二预定时间周期内或更长时间内未输入与 第二域对应的用户语音,提供通过将第一用户语音输入到人工智能模型中而获取的第一响 应声音。 识别用户可以包括基于相机捕获的图像或通过麦克风输入的用户语音中的至少 一个,来识别用户。 识别发出第一用户语音的用户可以包括,基于在输入第一用户语音的时间周期内 包含在图像中的用户嘴形,来识别发出第一用户语音的用户,以及提供第二响应声音可以 7 CN 111587419 A 说 明 书 4/24 页 包括,基于在输入第二用户语音的时间周期内包含在图像中的已识别出的用户嘴形发生了 变化,识别出发出第二用户语音的用户与发出第一用户语音的用户相同。 有益效果 根据本公开的上述实施例,当用户语音分别由多个用户输入时,该电子设备能够 通过基于现有用户语音处理、延迟或分别处理多个用户的语音,在维持上下文的同时提供 响应。 附图说明 图1a和图1b是用于解释根据实施例处理多个用户语音的方法的示意图; 图2是示出了根据实施例提供对用户语音响应声音的电子系统的示意图; 图3a是用于解释根据实施例的电子设备的配置的框图; 图3b是示出了根据实施例的电子设备的具体配置的框图; 图4a和图4b是用于解释根据实施例对多个用户中的用户语音延迟处理的示意图; 图5a至图5c是用于解释根据实施例实时同步处理多个用户语音的方法的示意图; 图6是用于解释根据实施例与多个用户的集体交互的示意图; 图7是用于解释根据实施例当输入了同一用户的与多个域分别对应的多个用户语 音时的操作示意图; 图8a和8b是用于说明根据实施例识别发出用户语音的用户的方法的示意图; 图9a和9b是用于解释根据实施例的人工智能模型的附加训练的示意图; 图10是用于解释根据实施例存储人工智能模型的电子设备的操作的流程图; 图11是用于解释根据实施例的电子设备和存储人工智能模型的外部服务器的操 作的时序图; 图12是用于解释根据实施例的外部服务器的配置框图,该外部服务器用于训练和 使用人工智能模型,以提供对用户的请求的响应; 图13是示出了根据实施例的学习单元的框图; 图14是示出了根据实施例的响应单元的框图; 图15是示出了根据实施例的电子设备和外部服务器相互连接以训练和识别数据 的例子的示意图; 图16是用于解释根据实施例的电子设备的控制方法的流程图。